Retour sur l’atelier citoyen proposé par l’École des Données le 10 novembre 2017 au Liberté Living-Lab à Paris, sur le thème du budget participatif, où une quinzaine de personnes ont participé.

Cet atelier de 3h fait partie de la série d’ateliers citoyens proposés par la ville de Paris, qui sont des programmes courts de formations théoriques ou pratiques sur la vie de la Cité, ouverts à toute personne souhaitant “apprendre et approfondir un sujet lui tenant à cœur ou tout simplement par curiosité”. Les Ateliers Citoyens de Paris sont aussi des temps de rencontres et de débats, et c’est dans ce cadre que l’École des Données a été sélectionnée pour proposer une série d’ateliers tout au long de l’année scolaire 2017-2018.

Au coeur des débats concernant la participation citoyenne et la démocratie locale, le dispositif du budget participatif mis en place par la Ville de Paris depuis 2014, interroge sur beaucoup d’aspects et sur autant de questions auxquelles nous pouvons tenter de répondre avec des données.

C’est donc tout naturellement que l’École des Données s’est proposée d’aller à la rencontre des citoyen.ne.s ayant la volonté de comprendre et de mesurer le succès ou l’impact du budget participatif avec des données, l’objectif de l’atelier étant aussi de donner des clés d’appropriation sur les enjeux du budget participatif, ainsi que de transmettre la culture de la donnée.

Retrouver ici la présentation donnée pendant l’atelier

La participation citoyenne au coeur de notre message

L’atelier s’est ouvert sur un bref rappel des fondamentaux de l’histoire des données ouvertes, en introduisant l’Open Definition comme base. Nous voulions rappeler l’historique de la démarche, sous quels principes par exemple fleurissent les portails open data, et arriver au constat que souvent, c’est l’administration qui choisit quelles données ouvrir, comment les ouvrir, quand (mises à jour), ce qu’elles contiennent et que même si la démarche est louable vers plus de transparence et de redevabilité, ce n’est pas forcément avec ces données que l’on répond aux questions que se posent les citoyen.ne.s.

.@cecileLG commence l’atelier #ecolesdesdonnees sur les données du budget participatif par une présentation de l’#opendefinition pic.twitter.com/YPKuvbVpcG

— OpenKnowledge France (@okfnFr) November 10, 2017

https://platform.twitter.com/widgets.js

Nous nous sommes attachés à montrer l’importance de la participation citoyenne dans ce domaine aussi. Comprendre comment les donnés sont publiées donne du pouvoir d’agir, et cela permet ensuite de pouvoir proposer des améliorations, dialoguer avec les éditeurs de données, et finalement faire entendre sa voix.

Nous avons rappelé également les dispositifs existants et mis en place par la Ville de Paris pour faire entendre cette voix :

- Sur Twitter avec les comptes @Parisjecoute et @opendataParis

- La plateforme sollicitations (https://sollicitations.paris.fr/) accessible via Mon Compte (le compte unique en ligne qui permet d’accéder à tous les services proposés par la Ville de Paris)

- Le formulaire sur le portail Open Data : https://opendata.paris.fr/pages/contact/

Ensuite, pour dérouler l’atelier, nous nous sommes appuyés sur la méthodologie de la data pipeline, développée par le réseau School of Data auquel appartient l’École des Données. Cela consiste en une approche en sept étapes qui permet de travailler avec des données du début à la fin. Loin d’être un dogme, cette approche est en constante progression, et est ouverte à toute suggestion ou modification par la communauté de personnes qui en fait l’expérience.

Une première étape : définir

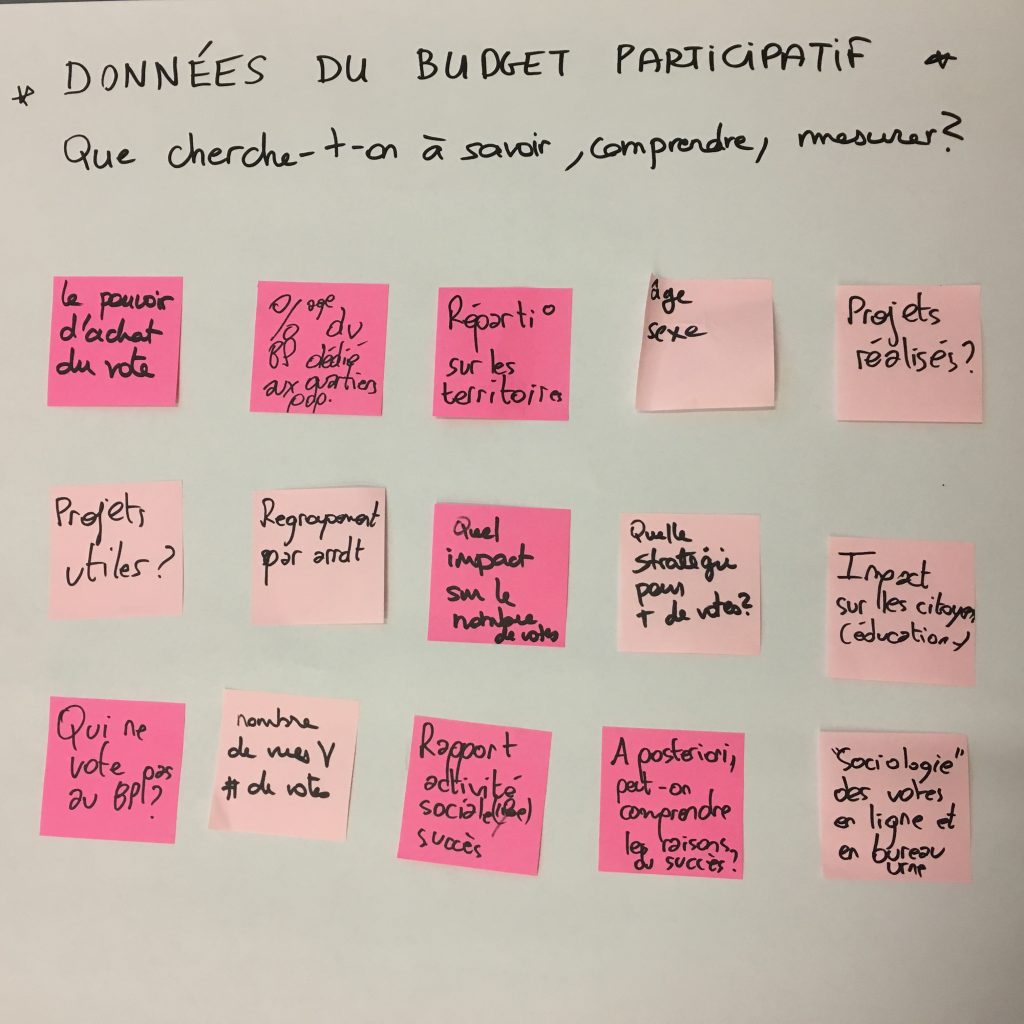

La première étape consiste donc à définir ce que l’on cherche dans les données. Nous avons donc posé la question “Que cherche-t-on à savoir, à comprendre, à mesurer ?” aux participant.e.s et avons noté les réponses sur des posts-its au fur et à mesure qu’elles étaient exprimées.

Deuxième étape : trouver les données du Budget Participatif

Nous avons ici regardé quelles étaient les sources potentielles de données concernant le Budget Participatif et nous avons rapidement listé pour les besoins de l’atelier :

- La plateforme open data de la Ville de Paris et en particulier le jeu Résultats des votes du Budget Participatif

- Le site du budget participatif : budgetparticipatif.paris.fr

- Le site de la Ville de Paris : la page des résultats du budget participatif

- Articles de journaux :

- Budget participatif 2017 : les pires projets auxquels on aimerait échapper

- [Data] Budget participatif : la dure quête des votes (2015) – la Gazette des communes

- Budget participatif : les Parisiens plébiscitent les projets Propreté et Verdure (Le Monde)

- Budget participatif à Paris : 5 % des projets d’investissements confiés aux citoyens (Les décodeurs, Le Monde)

- Le rapport de l’APUR : Budget Participatif : à quoi rêvent les parisiens ? Analyse des projets soumis en 2015

Vérifier les sources, le rôle des métadonnées

Comment s’assurer que les données sont valides, à jour, quelle est leur méthodologie de collecte, qui est le producteur des données, est-ce une source crédible ? Une façon de le faire est de lire ce qu’on appelle les métadonnées, ces informations qui décrivent les jeux de données. Elles renseignent sur le contenu des jeux de données et permettent en plus de pouvoir vérifier la source, de les indexer, donc de les trouver. Par exemple, un titre clair, précis et représentatif du contenu du jeu de données permettra plus facilement de les identifier. La description du jeu de données est aussi très importante puisqu’elle a vocation à contenir des informations relatives au sujet, au lieu, à la date de publication et de mise à jour, sur la méthode de collecte ou encore la licence. Il est indispensable d’indiquer quelles sont les modalités de réutilisation des données, même si elles sont ouvertes.

Des métadonnées bien renseignées à l’intention des utilisateurs de données par exemple, devraient aussi renseigner une définition de chaque intitulé présent dans le jeu.

Exemple ici : comment sont définis les “quartiers populaires” Est-ce que l’on parle des quartiers prioritaires de la politique de la ville ? (notons que la description des urnes centrales est bonne et précise)

Les projets sont localisés par un point avec des coordonnées géographiques mais ce point désigne-t-il le centre du projet ? Comment sont localisés les projets qui concernent tout un arrondissement ?

Des outils pour nettoyer et pour les visualiser les données

Un des plus grands défis rencontrés dans le traitement des données est les erreurs. Ceux qui publient les données ne les remarquent pas toujours, dans beaucoup de cas, elles sont humaines et résultent de la mauvaise saisie de données, mais souvent révèlent des failles plus profondes sur la façon avec lesquelles elles sont collectées comme la très typique erreur de format des dates ou des montants financiers : 1000,00€ ou 1000.00€ ? Nous sommes le 11/11/2017 ou le 2017/11/11 ou le 11-11-17 ?

Petit classement non exhaustif des erreurs fréquentes

- Le mauvais format pour les dates

- Les représentations multiples

- Les doublons

- Les fautes d’orthographe

Lors de l’atelier, nous avons trouvé des cases vides dans les données par exemple.

Dès lors il devient un peu plus long et difficile que prévu d’analyser les données que nous nous sommes fixés. Mais qu’à cela ne tienne, voici quelques outils qui permettent de manipuler une base de données.

Excel / OpenCalc d’Open Office / Google Spreadsheets : à noter que si certaines opérations peuvent sembler accessibles sur des petits jeux de données comme celui du budget participatif (500 lignes), elles deviennent impossibles dès lors que le jeu de données est plus grand, plus lourd, plus massif. Dans ces cas là, il convient d’utiliser des outils comme Open Refine ou des langages propres à la data science comme R (tidydata, tidyverse) ou Python.

Une fois que nos données ont le format voulu pour les représenter, nous sommes passés par un rapide passage en revue des outils disponibles pour la visualisation de données.

Quel graphique utiliser pour quelle visualisation ? C’est justement la question à laquelle se propose de répondre le site DataViz catalogue (qui a d’ailleurs inspiré le projet Dataviz Card Game de l’École des Données)

Pour produire rapidement une visualisation, notons Datawrapper, l’outil développé à la base par et pour des journalistes, afin de permettre de produire des visualisations sans savoir coder, pour pouvoir les intégrer dans leurs articles.

Ce que nous avons cherché à analyser pendant l’atelier

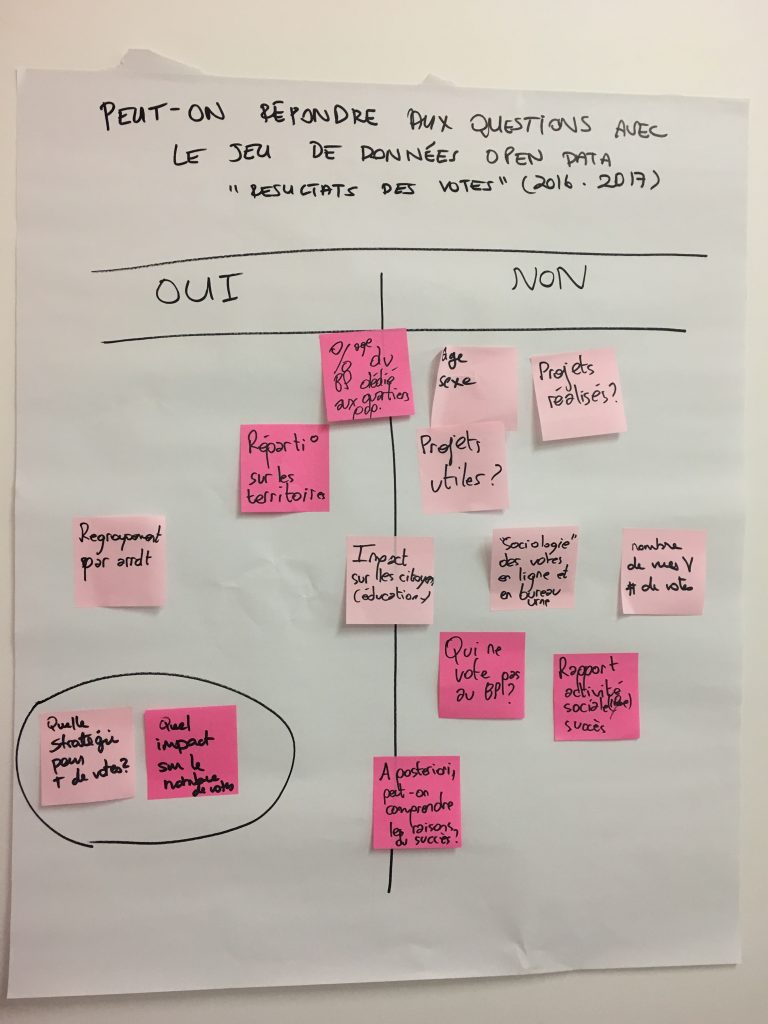

Un premier constat fut celui de réaliser que certaines réponses que nous cherchions initialement au début de l’atelier, ne se trouvaient pas dans le jeu de données publié en open data.

À partir de là et en nous concentrant sur les données disponibles, nous avons formulé d’autres questions et formé des petits groupes pour tenter de les représenter sous forme de graphiques :

Quel est le taux de participation de la population globale, et par arrondissement ?

Quel est le pourcentage des habitants qui ont voté par arrondissement par rapport à la population totale ?

Est-ce que les projets des quartiers populaires ont plutôt fait l’objet d’un vote en ligne ou d’un vote physique?

C’est lors de cet exercice que l’on se rend compte de la nécessité de l’étape “de nettoyage” des données, où s’y plonger concrètement demande de les manipuler un minimum et d’en extraire ce qu’il nous est nécessaire pour en faire une représentation.

Des propositions pour améliorer les données

Suite à la réflexion collective de l’atelier, un autre groupe s’est attaché à faire une liste de recommandations pour améliorer le jeu de données disponibles :

Donner des meilleurs noms aux fichiers : par exemple, le jeu actuel n’indique pas clairement dans le titre l’année ou les années des projets qui sont dans le jeu de données

Les jeux de données relatifs au budget participatif sur le portail apparaissent similaires mais n’ont pas à chaque fois le même nom

Harmoniser le schéma des jeux de données des années précédentes pour avoir les mêmes infos présentes si possible, le même nombre de colonnes (sinon préciser ce qui a changé)

- Proposer un fichier par année et un fichier global pour toutes les années

- Toujours utiliser la virgule pour marquer les décimales

- Il manque les données des votes physiques pour 2016 (au moins le total)

- Avoir la zone géographique quand le vote concerne l’arrondissement

Amélioration site open data : - Prévoir un endroit sur opendata où on peut poser des questions et demander des informations

- Le formulaire de demande de données n’est pas très visible et n’apparaît pas sur le menu principal

Demande de données :

- Avoir un jeu de donnée normalisé sur le suivi des projets, avec les grandes phases du planning (Études et conception, Lancement des procédures, Réalisation des travaux, Livraison et inauguration)

- Publier les statistiques web (durée de connexion pour le vote, sources de traffic, parcours de vote (utilisateurs)

- Mettre les url des projets si elles existent sur le site de suivi

- Publier les votes individuels sur le web sous une forme anonymisée garantissant la confidentialité

- Publier l’ensemble des projets proposés y compris ceux qui n’ont pas été jugés recevables

Les prochains ateliers de l’École des Données

Et pour la suite du programme, voici les prochains ateliers citoyens animés par l’École des Données :

Atelier 2 : Mon quartier. Nos données. Vers une infrastructure civique de la donnée en biens communs.

Samedi 16 décembre 2017 – de 14h00 à 17h00

Thématique : Inclusion numérique, gouvernance des données et souveraineté technique

Lieu : Ecole Normale Sociale, 2 Rue de Torcy, 75018 Paris

Comment mieux connaître mon quartier pour agir localement ? L’accès à l’information est déterminant dans la capacité des habitants et des associations à agir sur leur environnement. La manière de traiter ces données et d’organiser leur gouvernance détermine la ville d’aujourd’hui et de demain.

Cet atelier propose de faire le point sur les méthodes et les outils mobilisables pour collecter, analyser, héberger et mettre en commun les données locales, et construire une infrastructure civique de la donnée en biens communs.

S’inscrire ici ou sur le site de la Carte Citoyenne de Paris

Atelier 3 : Plan vélo – Paris n’est pas Amsterdam ?

Thématique : Transport

Date : Jeudi 18 janvier 2018 – de 19h00 à 22h00

Adopté en 2015 par le Conseil de Paris, le Plan Vélo Paris vise à tripler les déplacements à bicyclette dans la capitale d’ici 2020 et parvenir à 15% de trajets quotidiens. Mais la mise en œuvre de ce plan ne va pas de soi pour tout le monde, en particulier pour les associations d’automobilistes qui dénoncent les nuisances et l’impact négatif sur la mobilité. Au delà de la confrontation médiatique entre pro et anti bicyclette, cette situation pose des questions légitimes sur le partage de l’espace public et la transition vers de nouveaux modes de transport. Cet atelier propose ainsi d’explorer par la donnée les principaux enjeux qui entourent le développement du vélo à Paris et de s’interroger sur la place de la bicyclette dans la ville du futur. En particulier, nous nous demanderons si le vélo peut être une réponse adaptée à tous les types d’espace urbain ou si, au contraire, il ne peut se développer que dans des types de villes bien spécifiques.

Atelier 4 : Mon quartier. Nos données. Vers une infrastructure civique de la donnée en biens communs.

Thématique : Inclusion numérique, gouvernance des données et souveraineté technique

Date : Samedi 17 mars 2018 – de 14h00 à 17h00

Comment mieux connaître mon quartier pour agir localement ? L’accès à l’information est déterminant dans la capacité des habitants et des associations à agir sur leur environnement. La manière de traiter ces données et d’organiser leur gouvernance détermine la ville d’aujourd’hui et de demain.

Atelier 5 : Le parisien et l’adaptation au changement climatique

Thématique : Changement climatique, catastrophes naturelles

Date : Jeudi 19 Avril 2018 – de 19h00 à 22h00

Crues, canicules, tempêtes, en raison du changement climatique ces phénomènes devraient s’intensifier dans les prochaines années. Mais les experts et citoyens ont-ils les données nécessaires pour prévenir et faire face à ce type d’aléas ? Cet atelier propose d’explorer par la donnée les risques de catastrophes naturelles pour la Ville de Paris et d’identifier les informations essentielles dont nous avons besoin, comment les produire, et comment les communiquer au plus grand nombre.

Bonjour,

Avez vous pu avoir des nouvelles données depuis cette session qui semblait encourageante.

Avez vous un tableau des projet déposé par date ?

Je constate une forte baisse de nombre de projet déposé à moins d’une semaine de la fin des appels à idées il y a 20 projets dans le 11e alors qu’en 2017 117 avait été déposé (ce qui était déjà une baisse significative part rapport à 2016)

Jean-Baptiste Ingold

Collectif @VertNation